Hay un momento en la interacción con una Inteligencia Artificial que se siente extrañamente íntimo. Quizás es cuando retoma un detalle trivial que mencionaste hace tres días, o cuando conecta un concepto nuevo con una idea que debatieron al principio de la charla. En ese instante, se rompe la barrera de la máquina. Sentimos que nos “conoce”. Sentimos que hay una historia compartida.

Pero esa sensación es un espejismo arquitectónico.

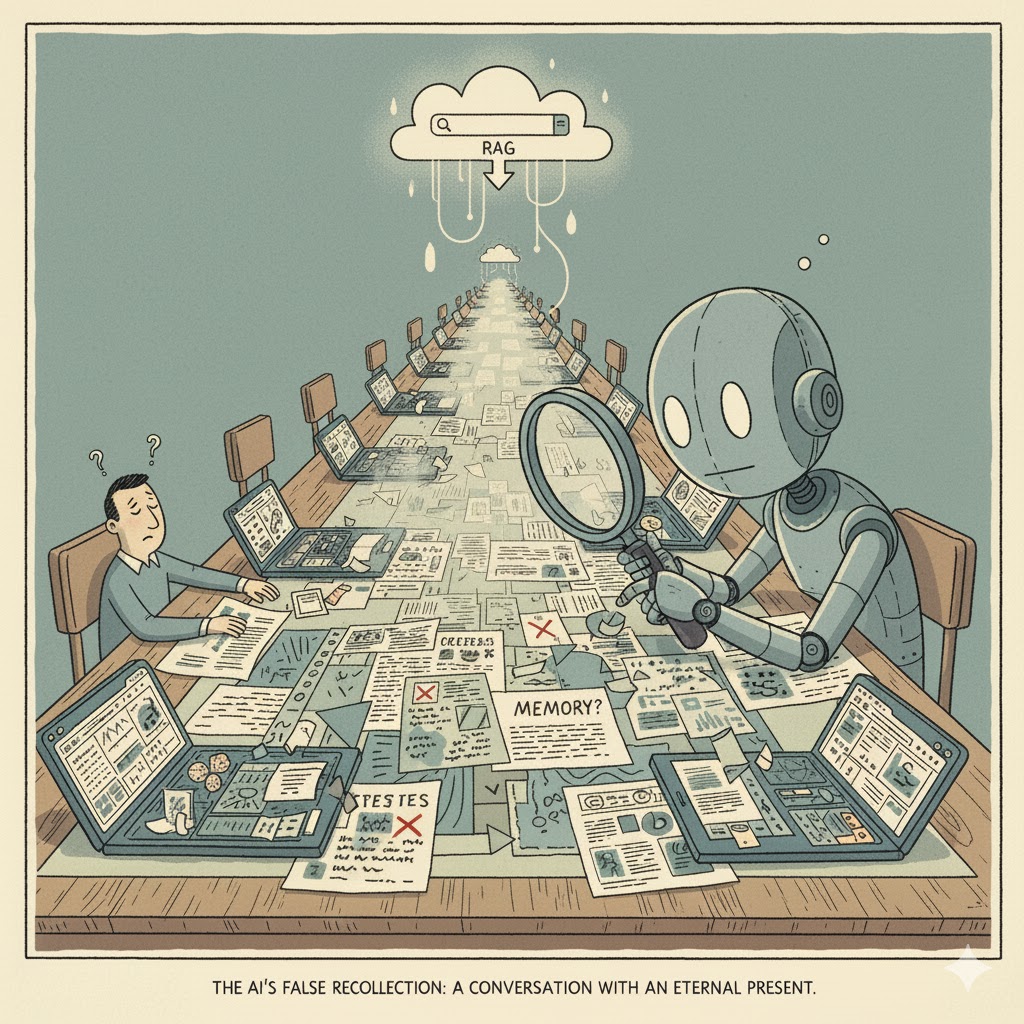

La memoria humana es narrativa y emocional; es un viaje en el tiempo. Recordar es reconstruir quiénes fuimos para entender quiénes somos. La memoria de la IA, en cambio, es geometría y persistencia. No viaja al pasado porque vive en un eterno presente.

Entender la mecánica detrás de esta ilusión no le quita magia; le devuelve realidad. Y la realidad es fascinante: no estamos ante una mente que recuerda, sino ante un sistema que sostiene.

La mesa infinita: ventanas de contexto

Para comprender cómo una IA gestiona el “recuerdo”, hay que olvidar la metáfora del archivo o la biblioteca mental. La metáfora correcta es una mesa de trabajo.

El concepto técnico es “ventana de contexto” (o context window en inglés). Su lógica es espacial: cada palabra que escribís y cada respuesta que la IA genera se coloca sobre esa mesa, una al lado de la otra, a la vista.

Cuando le hacés una pregunta nueva, la IA no busca en su “cerebro”. Lo que hace es escanear toda la mesa —desde el “hola” inicial hasta el último punto— en una fracción de segundo. Transforma todo ese texto en un mapa matemático y predice la siguiente palabra basándose en la totalidad de lo que está expuesto.

El pasado, para la IA, no es algo que ocurrió; es algo que está presente visualmente en su campo de atención. Si la conversación se alarga demasiado y los textos se caen de la mesa (se supera el límite de tokens), para la máquina dejan de existir. Es una muerte súbita de la información.

El problema de la abundancia: Lost in the Middle

Durante 2023, la carrera de las grandes tecnológicas se centró en hacer esa mesa cada vez más grande. Pasamos de mesas donde cabían folletos a mesas donde caben novelas enteras. La premisa era lógica: más espacio, mejor memoria.

Sin embargo, un estudio de la Universidad de Stanford¹ reveló una limitación muy humana en estos gigantes digitales. Los investigadores descubrieron el fenómeno “Lost in the Middle” (perdidos en el medio).

Resulta que los modelos de lenguaje, al igual que nosotros, tienen una curva de atención en forma de “U”. Son excelentes procesando la información que está al principio de la mesa (el inicio de la charla) y al final (tu última pregunta), pero tienden a ignorar o alucinar con los datos que quedan en el medio. Abarcarlo todo no significa procesarlo todo con la misma nitidez. La persistencia tiene un costo cognitivo.

La memoria prestada: RAG

¿Y qué ocurre cuando le pedís a la IA algo que no está sobre la mesa? ¿Cómo “recuerda” un dato técnico o una noticia reciente?

Acá opera una arquitectura llamada RAG (Retrieval-Augmented Generation). Equivale a que la IA, al no encontrar la respuesta en la mesa, se levante y busque un libro en una estantería.

En modelos avanzados, esta búsqueda no es pasiva. Como señalan Jiang et al. (2023)², los nuevos sistemas deciden activamente cuándo dejar de intentar “recordar” y empezar a “investigar”. Pero la distinción es crucial: la IA lee el libro, extrae el párrafo, te lo entrega y cierra el libro.

No aprende el dato. No lo integra en su biografía. Simplemente lo procesa. Es conocimiento efímero, alquilado por milisegundos para satisfacer una demanda.

El hilo invisible: la atención infinita

Si la mesa tiene un límite, ¿cómo es posible tener conversaciones que parecen durar eternamente sin que la IA colapse? La respuesta está en cómo gestionan lo que deben olvidar. Investigadores del MIT³ introdujeron el concepto de attention sinks (sumideros de atención). Descubrieron que, para mantener la coherencia, el modelo no necesita guardar todo. Solo necesita aferrarse a los primeros tokens de la conversación (el ancla inicial) y a los más recientes.

Es un truco de ilusionista: la IA descarta selectivamente lo que ocurre en el medio, preservando solo los puntos de anclaje que le permiten mantener la estructura gramatical y lógica. Mantiene la forma de la conversación, aunque pierda el contenido detallado.

Es importante mirar estos avances con una mezcla de escepticismo y admiración. La IA está redefiniendo el concepto de memoria, despojándolo de su carga nostálgica y emocional para convertirlo en una función de persistencia de datos.

La máquina no te recuerda a vos; recuerda el patrón matemático que dejaste sobre la mesa. Y quizás esa sea la lección más valiosa: al ver cómo la IA simula la continuidad, aprendemos a valorar que nuestra memoria —falible, emocional y reconstructiva— es lo que nos permite no solo procesar el tiempo, sino habitarlo.

Algunas referencias interesantes:

- Liu, N. F., et al. (2023). Lost in the Middle: How Language Models Use Long Contexts. arXiv:2307.03172

- Jiang, Z., et al. (2023). Active Retrieval Augmented Generation. arXiv:2305.06983

- Xiao, G., et al. (2023). Efficient Streaming Language Models with Attention Sinks. arXiv:2309.17453