Alguien que leyó todos los libros del mundo sobre cocina sabe teóricamente cómo se hace una tortilla, pero si nunca rompió un huevo, no tiene idea de la fuerza necesaria para hacerlo sin hacer un desastre. Puede definir la palabra “cerca”, pero no tiene la intuición física de cuánto es esa distancia.

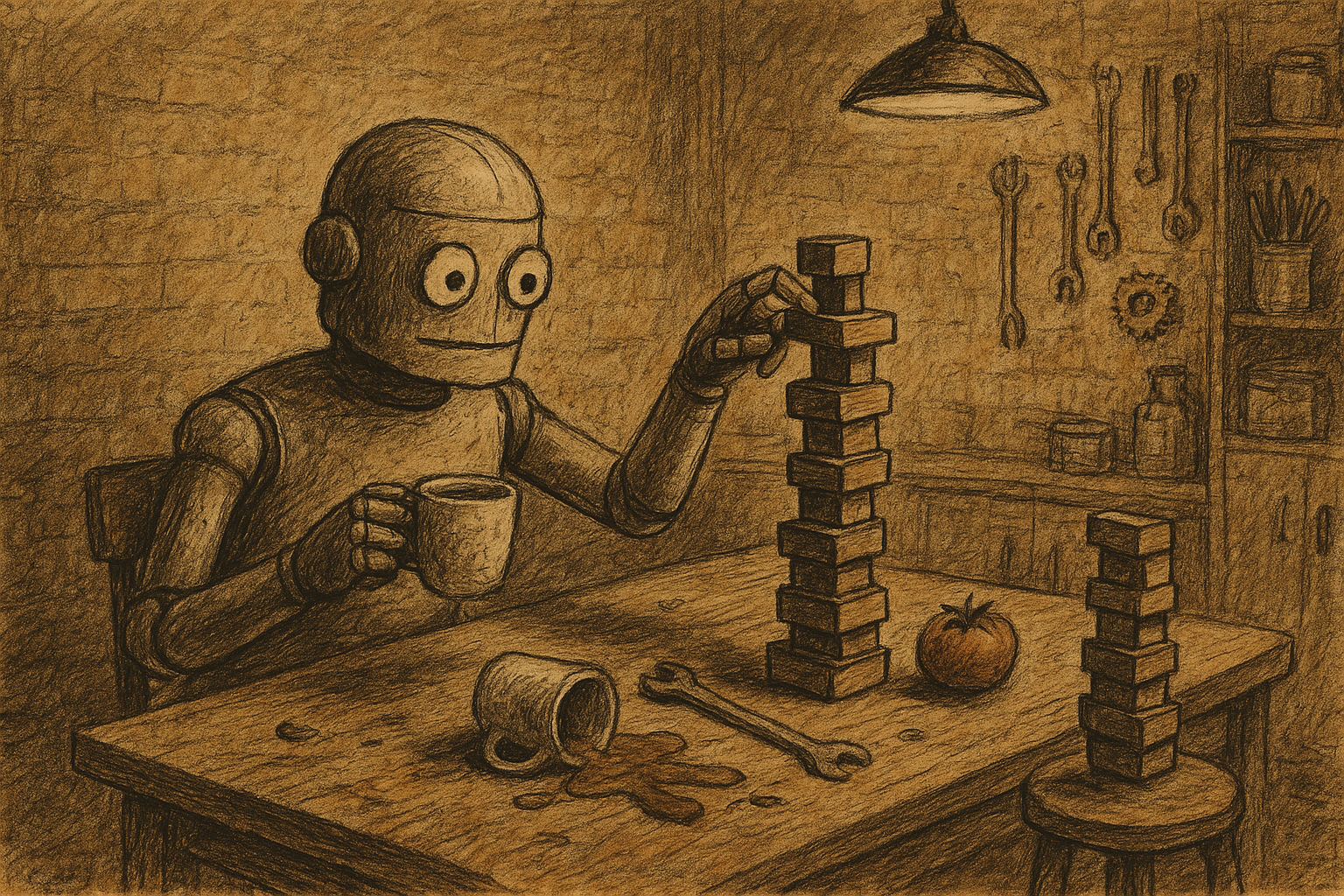

Esto es, en esencia, el gran drama de la inteligencia artificial actual. Los grandes modelos de lenguaje son cerebros incorpóreos flotando en el espacio digital. Pueden escribir ensayos brillantes sobre fenomenología o recitarte el manual de mantenimiento de una central nuclear, pero fundamentalmente no saben lo que se siente sostener una herramienta, ni entienden la resistencia de los materiales. Y acá está el límite: si los científicos quieren que la IA sea verdaderamente útil en el mundo real: en fábricas, hospitales o en los hogares, no alcanza con capacidad de cómputo: necesita un cuerpo.

Esta desconexión no es un problema menor; es lo que en ciencias cognitivas llaman el problema del “symbol grounding” (anclaje de símbolos). La IA sabe que la palabra “manzana” se relaciona con “fruta”, pero no tiene ninguna experiencia sensorial que ancle ese concepto a la realidad física.

Esta idea tiene raíces profundas. En 1991, Rodney Brooks en el MIT publicó un paper fundamental: Intelligence without Representation. Brooks argumentaba en contra del paradigma cartesiano dominante, que veía a la mente como un procesador lógico separado del cuerpo. Él sostenía que la inteligencia no emerge de crear mapas mentales complejos y abstractos, sino de la interacción directa, caótica y física con el entorno (¿quizás influenciado por Dreyfus o Merleau Pointy: la inteligencia es “estar en el mundo?). El mundo, decía Brooks, es su propio mejor modelo. Pero durante décadas, nos faltó la tecnología para unir esa visión filosófica con la capacidad de procesamiento moderna. Los robots podían moverse, pero no entendían qué estaban moviendo.

Hoy esa brecha se está cerrando gracias a una nueva arquitectura técnica: estamos viendo el nacimiento de lo que papers recientes (como la encuesta de Ma et al., 2024) que clasifican como Vision-Language-Action models (VLAs). La gran innovación aquí no es mecánica, sino semántica. Modelos como RT-1 y RT-2 demostraron algo fascinante: si tratamos las acciones de un robot (mover brazo, abrir pinza) como si fueran “palabras” o tokens, podemos usar la misma arquitectura “Transformer” de ChatGPT para controlar un cuerpo. Esto permite algo inédito: transferir el vasto conocimiento de internet al mundo físico. El robot ya no necesita ser programado para identificar una “lata de gaseosa”; puede usar su conocimiento previo de internet para entender qué es una bebida, para qué sirve y cómo se agarra, incluso si nunca vio esa marca específica antes.

Sin embargo, entrenar estos modelos en el mundo real es muy lento y sobre todo, peligroso. Por eso se comenzó a utilizar un campo de entrenamiento inesperado: los videojuegos. Proyectos recientes como SIMA 2 de DeepMind utilizan entornos virtuales complejos para entrenar a estas inteligencias antes de descargarlas en un robot. Lo revolucionario de SIMA 2 es que usa un modelo masivo (Gemini) para razonar antes de actuar. Si le pedís “buscá una casa del color de un tomate”, el sistema no busca píxeles aleatorios; razona semánticamente que los tomates son rojos y, por ende, debe buscar una estructura roja. Esta capacidad de conectar instrucciones abstractas con percepción visual y acción motora es el eslabón perdido de la robótica.

La lógica de usar simulaciones es difícil de igualar y retoma aquel viejo principio de Brooks: un robot físico que aprende a caminar se rompe y cuesta miles de dólares reparar; un agente en un videojuego puede caerse, chocar y “morir” mil veces por segundo sin costo, aprendiendo causalidad, física y consecuencias en el proceso.

Estamos pasando de una IA cartesiana que separa la mente del cuerpo a una verdaderamente encarnada (o embodied). El objetivo final no es que jueguen videojuegos ni que solo respondan preguntas, sino que desarrollen la “cognición situada” necesaria para operar en nuestro mundo desordenado. Los investigadores están empezando a encontrar el cuerpo que estaban buscando para la inteligencia artificial.

Referencias y papers interesante

- Brooks, R.A. (1991). “Intelligence without Representation“. Artificial Intelligence, 47(1-3).

- SIMA Team (2024). “Scaling Instructable Agents Across Many Simulated Worlds“. arXiv:2404.10179.

- Brohan, A., et al. (2022). “RT-1: Robotics Transformer for Real-World Control at Scale“. arXiv:2212.06817.

- Brohan, A., et al. (2023). “RT-2: Vision-Language-Action Models Transfer Web Knowledge to Robotic Control“. arXiv:2307.15818.

- Driess, D., et al. (2023). “PaLM-E: An Embodied Multimodal Language Model“. arXiv:2303.03378.

- Ma, Y., et al. (2024). “A Survey on Vision-Language-Action Models for Embodied AI“. arXiv:2405.14093.

- Sapkota, H., et al. (2025). “Vision-Language-Action Models: Concepts, Progress, Applications and Challenges“. arXiv:2505.04769.